Depuis la révolution industrielle, peu de technologies ont eu le potentiel de bouleverser l’ordre mondial avec autant de fulgurance que l’Intelligence Artificielle (IA). Désormais qualifiée de « technologie à usage général » (General Purpose Technology), au même titre que l’électricité ou l’imprimerie, l’IA transcende le simple cadre de l’ingénierie informatique pour redéfinir les paradigmes de la puissance, de l’économie et, inévitablement, des relations internationales. Dans ce contexte de mutation technologique rapide, la diplomatie — art séculaire historiquement fondé sur le dialogue, l’intuition et la subtilité humaine — se trouve à l’aube d’une transformation systémique.

L’intégration de ces architectures cognitives au sein des ministères des affaires étrangères et des organisations internationales soulève une interrogation fondamentale : comment le diplomate moderne peut-il valablement tirer profit de l’intelligence artificielle pour optimiser la prise de décision stratégique, affiner l’analyse géopolitique et anticiper la gestion des crises, tout en naviguant avec prudence dans un écosystème complexe de risques et de régulations émergentes ?

Pour répondre à cet enjeu stratégique, il convient en premier lieu de retracer la trajectoire historique de l’IA afin de cerner son basculement récent vers un outil géopolitique majeur. Nous explorerons ensuite les secteurs spécifiques de l’action diplomatique où la collaboration homme-machine apporte aujourd’hui une plus-value opérationnelle indéniable. Cette analyse impliquera d’évaluer avec rigueur les risques inhérents à ces technologies, tels que les biais algorithmiques ou la désinformation, justifiant ainsi l’impératif de cadres de gouvernance mondiaux et éthiques robustes. Enfin, nous verrons pourquoi l’IA, loin de remplacer le diplomate, s’impose d’ores et déjà comme le catalyseur incontournable de sa performance future.

De la Machine de Turing aux LLM : Brève Historique de l’IA dans le Contexte Stratégique

Pour appréhender l’impact actuel de l’Intelligence Artificielle sur la scène internationale, il est indispensable de déconstruire le mythe d’une technologie apparue ex nihilo. L’IA s’inscrit dans une trajectoire historique longue, jalonnée de percées théoriques et de périodes de stagnation, qui éclairent sa nature actuelle de puissance géopolitique.

Les fondations théoriques : De l’itération mécanique à la conception de l’intelligence

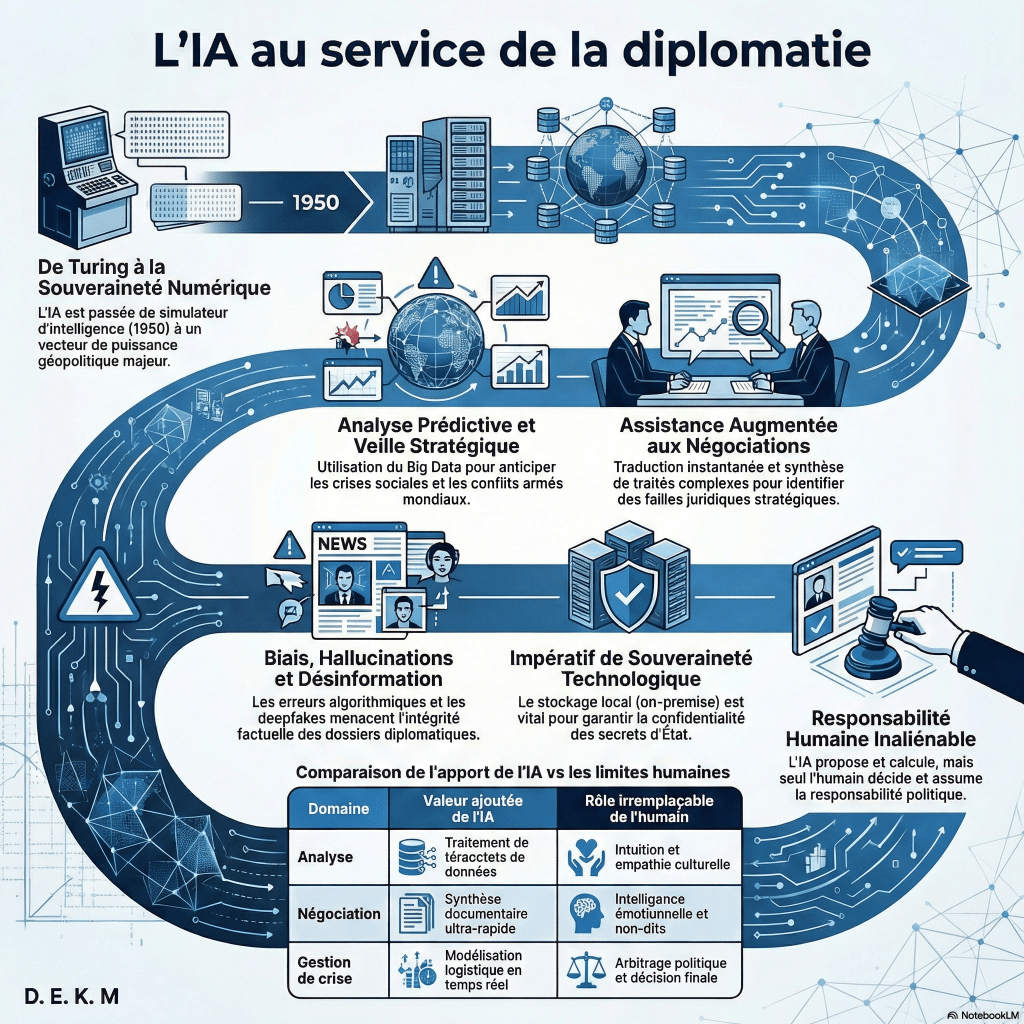

Bien avant l’ère du silicium, les bases conceptuelles de l’IA émergent avec la machine analytique de Charles Babbage et les principes de programmation d’Ada Lovelace au XIXe siècle. Toutefois, le véritable point de bascule survient en 1950, lorsque le mathématicien britannique Alan Turing publie son célèbre article introduisant le « jeu de l’imitation » (connu sous le nom de Test de Turing). En s’interrogeant non pas sur la capacité intrinsèque des machines à penser, mais sur leur capacité à simulerl’intelligence humaine, Turing pose le cadre philosophique et technique de l’IA. Quelques années plus tard, la conférence de Dartmouth de 1956 marque la naissance officielle du domaine de recherche, forgeant l’ambition de décrire et de reproduire chaque aspect de l’apprentissage humain par des systèmes computationnels.

L’évolution technologique : Des « hivers de l’IA » à la révolution de l’IA Générative

L’évolution de l’IA n’a pas été linéaire. La discipline a traversé ce que les experts nomment des « hivers de l’IA » (notamment dans les années 1980), caractérisés par une baisse drastique des financements gouvernementaux et une perte de confiance face aux limites techniques de l’époque. La renaissance technologique s’est opérée plus tard, catalysée par l’explosion de la puissance de calcul et l’accumulation massive de données (Big Data).

L’apprentissage automatique (Machine Learning) s’est d’abord imposé par le biais de l’apprentissage supervisé(Supervised Learning), où les algorithmes apprennent à résoudre des problèmes spécifiques à partir de vastes jeux de données minutieusement étiquetées. Par la suite, l’avènement de l’apprentissage profond (Deep Learning), basé sur des réseaux de neurones artificiels complexes à multiples couches, a permis aux machines d’extraire de manière autonome des schémas (patterns) au sein de données non structurées. Plus récemment encore, l’architecture neuronale des « Transformers » a rendu possible l’émergence des modèles fondationnels et des Grands Modèles de Langage (LLM). Ces systèmes de pointe ne se contentent plus d’analyser l’information : ils maîtrisent l’inférence probabiliste pour générer du contenu sémantique inédit (texte, analyse, traduction) avec une fluidité quasi humaine.

Le basculement diplomatique : De l’outil informatique à l’atout géostratégique

Historiquement cantonnée aux laboratoires de recherche en sciences informatiques, l’IA a récemment opéré une mutation de statut radicale. Elle est passée du stade d’outil d’optimisation industrielle à celui de véritable vecteur de souveraineté nationale. Dans l’arène mondiale actuelle, la maîtrise des technologies d’IA — ainsi que de la chaîne de valeur qui la soutient, des semi-conducteurs aux centres de données — dicte la hiérarchie de la puissance.

Ce basculement force l’émergence d’une véritable cyberdiplomatie. Désormais, le diplomate se trouve investi d’une double mission : participer activement à l’élaboration de cadres normatifs internationaux pour réguler ces technologies (IA de défense, régulation des usages civils), et intégrer simultanément ces mêmes outils cognitifs au cœur de son appareil d’État afin de maintenir la compétitivité et la pertinence de son réseau diplomatique.

L’IA en Action : Les Domaines de la Diplomatie Révolutionnés par les Algorithmes

L’intégration de l’IA dans l’appareil d’État ne relève plus de la prospective ou de la science-fiction ; elle se déploie déjà activement pour augmenter les capacités analytiques et opérationnelles des missions diplomatiques. Trois domaines illustrent particulièrement cette synergie homme-machine.

L’analyse géopolitique et la veille prédictive (Machine Learning et Big Data)

Le diplomate contemporain est quotidiennement submergé par des téraoctets de données non structurées (rapports diplomatiques, presse locale, flux de réseaux sociaux). L’apprentissage automatique permet d’ingérer ce Big Data pour en extraire des signaux faibles invisibles à l’œil nu.

- Exemple édifiant : Les systèmes d’alerte précoce. En croisant l’analyse des sentiments sur les plateformes numériques avec des indicateurs macroéconomiques (inflation, flambée du prix des denrées alimentaires), l’IA peut modéliser la probabilité d’une crise sociale ou d’un conflit armé. Des mécanismes tels que ceux soutenus par l’ONU (comme le Complex Risk Analytics Fund – CRAF’d) démontrent comment l’analyse prédictive permet d’anticiper l’éclatement d’une crise, offrant ainsi une fenêtre d’opportunité inestimable pour la diplomatie préventive.

L’assistance aux négociations et la diplomatie linguistique (NLP)

La barrière linguistique et la complexité vertigineuse des traités multilatéraux sont des défis chroniques. Le Traitement du Langage Naturel (NLP), au cœur des modèles génératifs, révolutionne cet aspect grâce à la traduction instantanée de haute précision. Mieux encore, l’IA excelle dans l’ingénierie sémantique et la synthèse documentaire.

- Exemple édifiant : Lors de négociations commerciales ou climatiques impliquant des milliers de pages de textes techniques, des algorithmes d’analyse juridique (similaires aux outils de la LegalTech) permettent aux délégations de repérer instantanément des clauses ambiguës, de générer des synthèses comparatives des différentes propositions de résolution, ou d’identifier des failles dans le droit international. Cela confère un avantage asymétrique décisif aux délégations dotées de ces outils.

Les services consulaires et la gestion de crise

Sur le plan consulaire, l’IA métamorphose l’interaction entre l’État et ses ressortissants. Les agents conversationnels (Chatbots) propulsés par des LLM gèrent aujourd’hui les requêtes de routine (visas, état civil) 24h/24, libérant le personnel diplomatique pour des tâches à plus haute valeur ajoutée.

- Exemple édifiant : En situation de crise aiguë (catastrophe naturelle ou conflit soudain nécessitant un rapatriement), les algorithmes de logistique croisent en temps réel les données météorologiques, l’état des infrastructures et les flux de télécommunications pour modéliser des parcours d’évacuation sécurisés, optimisant ainsi les capacités de réponse rapide des centres de crise gouvernementaux.

Les Risques Inhérents : Biais Algorithmiques, Hallucinations et Sécurité

Si l’IA offre des leviers d’action inédits, son adoption non régulée expose l’appareil diplomatique à des vulnérabilités critiques qu’il convient d’identifier et de mitiger avec rigueur.

Les biais algorithmiques et la perpétuation des asymétries

Les modèles d’IA ne sont que le reflet des données sur lesquelles ils ont été entraînés. Si ces jeux de données sont incomplets ou reflètent des déséquilibres géopolitiques historiques (par exemple, une surreprésentation des sources médiatiques occidentales au détriment des pays du Sud), les recommandations de l’algorithme seront structurellement biaisées. Dans le cadre de l’octroi de visas ou de l’analyse d’une zone de conflit, un tel biais cognitif automatisé peut conduire à des décisions discriminatoires ou à des erreurs d’appréciation stratégiques majeures.

Désinformation, « hallucinations » et intégrité factuelle

Les Grands Modèles de Langage (LLM) ne raisonnent pas au sens humain du terme ; ils génèrent des suites de mots basées sur des probabilités statistiques. Ce mécanisme engendre parfois des « hallucinations », c’est-à-dire la production d’informations fausses mais sémantiquement très plausibles. S’appuyer aveuglément sur un précédent juridique ou historique « halluciné » par une machine lors de la rédaction d’un traité bilatéral serait désastreux. En outre, la prolifération des hypertruquages (deepfakes), générés par l’IA, menace l’intégrité de la preuve géopolitique, rendant la vérification des faits (fact-checking) plus complexe que jamais en temps de crise.

Souveraineté technologique et confidentialité des données

L’action diplomatique repose sur le secret et la confidentialité. Confier l’analyse de câbles diplomatiques, de notes blanches ou de stratégies de négociation à des modèles d’IA développés et hébergés par des entités privées étrangères constitue une faille de sécurité existentielle. Ces plateformes peuvent être soumises à des législations extraterritoriales permettant l’accès aux données. Le développement de modèles souverains, auditables et hébergés localement (on-premise), s’impose donc comme un impératif de sécurité nationale.

Cadrage Éthique et Politique : S’appuyer sur l’Expertise et la Régulation Globale

Face à cette asymétrie entre potentiel technologique et vulnérabilités systémiques, la diplomatie ne peut naviguer à vue. Il est impératif d’ancrer l’utilisation de l’IA dans un cadre de gouvernance stricte. Comme le souligne Corneliu Bjola, expert de renommée mondiale en diplomatie numérique, l’intégration de l’IA exige une révision structurelle des pratiques diplomatiques pour éviter le glissement vers une « diplomatie algorithmique » dépourvue de contrôle humain. De même, le philosophe Nick Bostrom alerte de longue date sur les risques systémiques profonds si l’alignement des valeurs entre la machine et l’humanité venait à échouer.

C’est pourquoi les chancelleries doivent s’appuyer sur des standards multilatéraux, tels que les Principes de l’OCDE sur l’intelligence artificielle, qui promeuvent une IA innovante, digne de confiance et respectueuse des droits humains. Sur le plan réglementaire, l’approche ex-ante s’impose progressivement comme le standard mondial, à l’image du récent Règlement sur l’IA de l’Union européenne (AI Act). Cette logique impose d’évaluer, de classifier et de certifier les systèmes d’IA selon leur niveau de criticité avant tout déploiement institutionnel.

Pour le diplomate, ce cadrage politique se traduit par deux impératifs techniques absolus. Premièrement, l’exigence d’une « IA explicable » (Explainable AI ou XAI) : le processus décisionnel de l’algorithme ne doit pas être une « boîte noire », le diplomate doit pouvoir comprendre et justifier comment le système est parvenu à sa recommandation. Deuxièmement, le maintien de la responsabilité (accountability) : en diplomatie, la machine propose, calcule et synthétise, mais la décision finale et sa responsabilité politique incombent toujours, et exclusivement, à l’agent humain.

L’IA, un Catalyseur et non un Remplaçant du Diplomate

L’intelligence artificielle représente indéniablement une révolution cognitive qui redéfinit l’arsenal diplomatique. Elle dote les ministères des affaires étrangères d’une puissance de calcul asymétrique, d’une capacité d’analyse prédictive inégalée et d’une vitesse de traitement de l’information autrefois inenvisageable.

Toutefois, l’art complexe de la diplomatie ne saurait être réduit à une suite d’inférences statistiques ou à un code binaire. L’IA reste fondamentalement dépourvue de ce qui fait l’essence même des relations internationales : l’intelligence émotionnelle, l’empathie, la conscience des traumatismes historiques, et cette subtilité culturelle indispensable pour interpréter un non-dit à une table de négociation.

En définitive, l’intelligence artificielle ne remplacera pas le diplomate. En revanche, il est une certitude absolue : le diplomate qui maîtrise et utilise l’IA remplacera indéniablement celui qui refusera de s’y adapter.

Références et Bibliographie

- Bommasani, R. et al. (2021). On the Opportunities and Risks of Foundation Models. Center for Research on Foundation Models (CRFM), Stanford Institute for Human-Centered AI (HAI). (Rapport soulignant les risques liés à l’homogénéisation et aux modèles fondationnels).

- Bostrom, N. (1998). How long before superintelligence?. International Journal of Future Studies, vol. 2. (Analyse des risques systémiques et temporels liés à l’intelligence artificielle générale).

- Bjola, C. & Holmes, M. (2015). Digital Diplomacy: Theory and Practice. Routledge. (Ouvrage de référence sur l’impact des technologies numériques sur la pratique diplomatique).

- Gutierrez, C.I., Aguirre, A., Uuk, R. et al. (2023). A Proposal for a Definition of General Purpose Artificial Intelligence Systems. Digital Society 2, 36. Springer.

- Ng, A. (2017). Artificial Intelligence is the New Electricity. Synced / Stanford MSx Future Forum. (Intervention conceptualisant l’IA comme une technologie à usage général transformant tous les secteurs).

- OCDE (2019). Recommandation du Conseil sur l’intelligence artificielle. (Cadre multilatéral promouvant une IA digne de confiance, innovante et respectueuse des droits humains).

- Parlement européen et Conseil de l’Union européenne (2024). Règlement européen sur l’intelligence artificielle (AI Act). (Modèle de régulation ex-ante basé sur les risques).

- Turing, A. M. (1950). Computing machinery and intelligence. Mind, 59(236), 433–460. (Texte fondateur établissant le cadre théorique de l’IA).

Laisser un commentaire